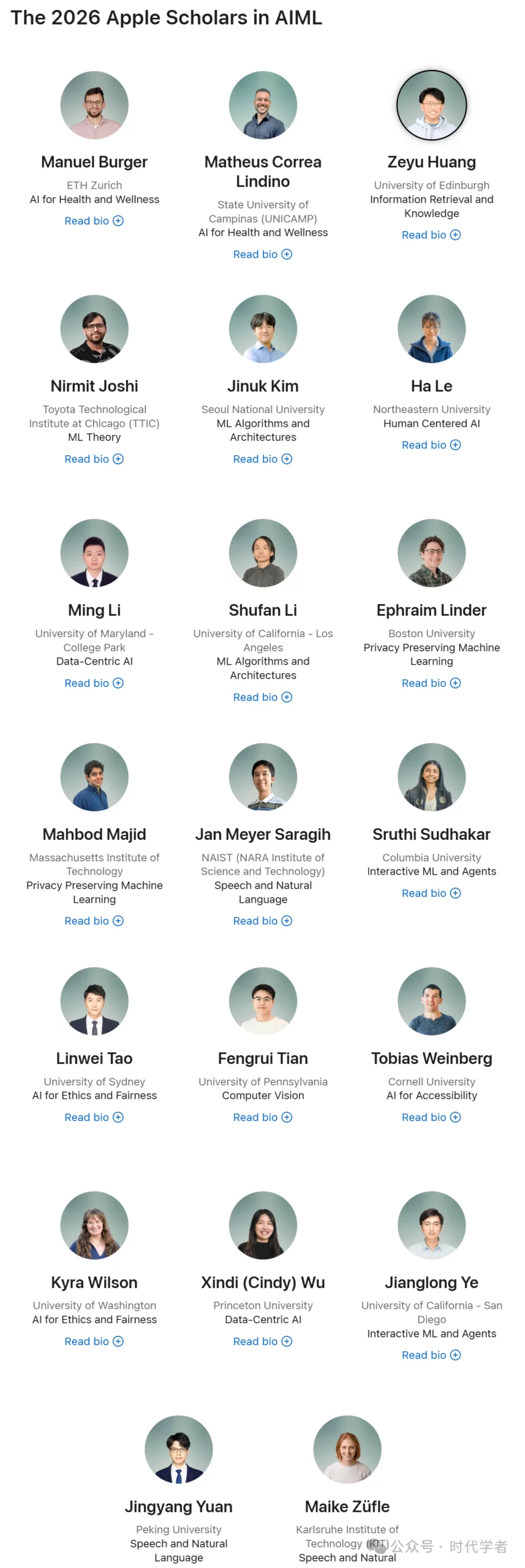

近日,苹果机器学习研究中心(Apple Machine Learning Research)正式公布了2026年AI(人工智能)、ML(机器学习)领域获得博士生奖学金的「苹果学者」名单。今年共有20位年轻学者获得了苹果学者计划的资助,其中包括了多位华人学者。

苹果博士奖学金旨在奖励和支持计算机科学与工程领域极具潜力的博士研究生开展研究,每年颁发一次,今年已是第七年,为120余位学者提供了支持。获奖者不仅可以获得奖学金支持,还能得到苹果实习机会和苹果研究员的学术指导。

在参与苹果的工作期间,历年的年轻学者已经共同撰写了60多篇顶会论文。以下是本年度获得奖学金的部分华人学者:

Zeyu Huang(黄泽宇),英国爱丁堡大学博士生。2020年毕业于北京航空航天大学,获得信息与计算科学专业学士学位;2023年毕业于北京航空航天大学,获得电子信息工程专业硕士学位;读研期间在腾讯、北京智源人工智能研究院实习。2024年开始在英国爱丁堡大学攻读自然语言处理专业博士学位,博士生导师是 Ivan Titov 和 Edoardo M. Ponti教授。他对设计通用的终身学习器感兴趣,在大语言模型底层研究上持续发力,在NeurIPS、ACL等顶会上有多篇论文成果,并获得过NAACL Outstanding Paper等奖项。

Ming Li(李明),美国马里兰大学帕克分校计算机科学专业三年级博士生,2020年在西安交通大学获得计算机科学学士学位;2023年在德州农工大学获得硕士学位,导师是Ruihong Huang教授。2023年开始在美国马里兰大学帕克分校攻读计算机科学专业博士学位,博士生导师是周天翼(北京理工大学本科校友)。他的研究方向聚焦于以数据为中心的人工智能、大语言模型后训练以及模型可解释性。他致力于研发全新的数据生成与评估技术,以此提升语言模型的推理能力、泛化能力与可控性。过去几年,他领导了多个研究项目,发表了10多篇第一作者论文,发表于包括ACL、NeurIPS、ICLR、EMNLP和NAACL等顶级学术领域。

Shufan Li(李书帆),美国加州大学洛杉矶分校计算机科学专业博士研究生,师从Aditya Grover教授。本科毕业于美国加州大学伯克利分校,获得数学与计算机科学学士学位。其研究方向主要为统一多模态生成模型与离散扩散大语言模型。他致力于以高效、可扩展的方式,将各类视觉理解与视觉生成能力整合至统一的模型框架中。

Linwei Tao(陶林伟),澳大利亚悉尼大学计算机视觉专业博士生,2017年本科毕业于华中科技大学,获得通信与工程专业学士学位;2021年在悉尼大学获得数据科学硕士学位;2023年开始在澳大利亚悉尼大学攻读计算机视觉专业博士学位,博士生导师是徐畅(天津大学本科校友、北京大学博士校友)教授。从2024年11月到现在,一年多时间里有5篇论文入选顶会,最近刚完成了谷歌研究院澳大利亚的实习。其研究聚焦于视觉与语言模型的置信度校准及不确定性表达,旨在提升人工智能的公平性与可信度,推动以人为本的人工智能落地应用。

Fengrui Tian(田豐瑞),美国宾夕法尼亚大学GRASP实验室二年级博士生,2021年本科毕业于西安交通大学,获得软件工程专业学士学位;2024年硕士毕业于西安交通大学,获得控制科学与工程专业硕士学位。2024年开始在美国宾夕法尼亚大学攻读博士学位,博士生导师是René Vidal。在读博之前,他还在清华大学担任研究实习生,并在上海AI Lab、商汤以及旷视实习过。他的研究兴趣广泛涵盖计算机视觉与计算机图形学领域。目前,他主要致力于研发人工智能驱动的三维世界生成系统,助力并加速工业领域的三维建模工作流程,重点提升模型的可扩展性、运行效率与画面真实感。

Xindi (Cindy) Wu(吴馨迪),美国普林斯顿大学计算机科学四年级博士生,2020年本科毕业于西安交通大学,获的计算机科学专业学士学位;2022年硕士毕业于卡内基梅隆大学,获得计算机视觉硕士学位;2022年开始在美国普林斯顿大学攻读计算机科学博士学位,导师是Olga Russakovsky教授。她的研究聚焦于高效多模态机器学习的数据相关研究,致力于研发以数据为核心的方法,追溯模型行为与训练数据构成的关联,打造具备高扩展性、高性能与强可控性的多模态系统。

Jianglong Ye(叶江龙),美国加州大学圣迭戈分校三年级博士生,2021年本科毕业于浙江大学,获得软件工程专业学士学位。2022年在加州大学圣地亚哥分校获得硕士学位;2023年开始在美国加州大学圣迭戈分校攻读博士学位,博士生导师:王小龙(华南农业大学本科校友,中山大学硕士校友)。他主要研究面向灵巧操作的机器人学习算法。其研究旨在规模化生成示范数据,并学习跨实体通用策略,让机器人能够在不同设备与环境中快速自适应。

Jingyang Yuan(袁景阳),北京大学博士生,主攻大语言模型高效架构研究。硕士毕业于北京大学。他首创原生稀疏注意力技术,大幅降低超长文本上下文的计算开销;同时推动稀疏注意力落地于深度求索(DeepSeek)系列模型,助力实现大语言模型高性能、低成本、可规模化的训练与部署。作为DeepSeek公司实习生,他在2024年主导完成《Natively Sparse Attention》论文研究,提出的原生稀疏注意力(NSA)机制有效突破传统Transformer架构的长文本处理瓶颈。

以下为2026年苹果学者入选名单:

![]()

计划申请2026年海外优青项目的申请人可以添加时代学者工作人员微信:shidaixuezhe2申请加入申报交流群(仅限申请人),需要了解更多海外引进项目机会、申请项目评估、匹配依托单位或海优申请书空白模板的海外学者也可以扫码交流。